Mais depuis que les LLM s’en mêlent, le vide a gagné en fluidité. Il arrive plus vite. Il sonne mieux. Il se relit moins. Et surtout, il se répète partout avec une régularité troublante.

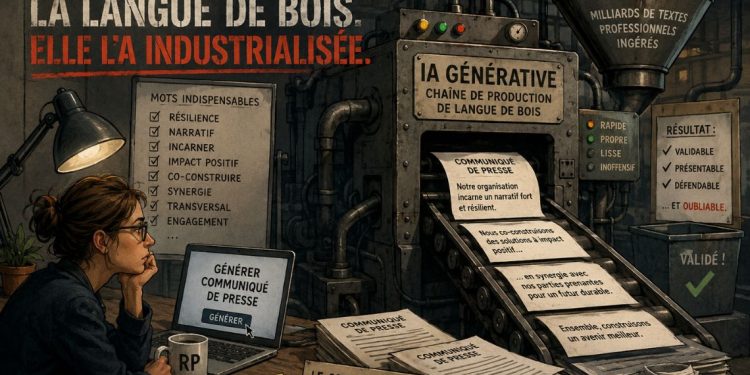

Quelqu’un, quelque part, a eu l’idée géniale de demander à une IA de rédiger son communiqué de presse. L’IA a répondu. Vite. Proprement. Avec exactement les mots qu’il fallait : « résilience », « narratif fort », « incarner les valeurs », « impact positif », « co-construire ». Le client a validé. L’attaché de presse a soufflé. Et quelque part dans les serveurs d’OpenAI, un modèle de langage a produit, sans le savoir, le communiqué parfait du secteur entier. Le problème, bien sûr, c’est que tout le monde a eu la même idée géniale.

Faites l’expérience. Ouvrez quelques communiqués récents. Pas besoin d’une étude scientifique, une boîte mail suffit. « Résilience » surgit dès qu’il faut parler d’une difficulté sans la nommer. « Narratif » donne l’impression qu’une stratégie existe là où il y a souvent seulement un sujet. « Incarner » transforme n’importe quelle abstraction en promesse de chair et d’os, sans que personne n’ait à préciser quelle chair ni quels os.

Pris séparément, ces mots ne sont pas forcément coupables. Placés en batterie, toujours au même endroit, dans le même ordre, avec le même air de ne pas y toucher, ils deviennent autre chose : une signature. Pas celle d’une agence. Pas celle d’un client. Celle d’une moyenne.

L’IA ne cherche pas la vérité. Elle cherche la moyenne

Un LLM ne pense pas. Il prédit. À chaque mot, il calcule celui qui a statistiquement le plus de chances de suivre le précédent, au regard de tout ce qu’il a ingéré. Et ce « tout » contient une quantité massive de communiqués de presse, de tribunes corporate, de prises de parole de dirigeants, de pitchs d’agences et de textes institutionnels produits depuis des années. Du meilleur, parfois. Du reste, souvent.

Quand un modèle a appris sur des millions de textes professionnels interchangeables, il ne produit pas une voix. Il produit la probabilité d’une voix.

Résultat : le texte professionnel moyen. Lisse. Équilibré. Inoffensif. Un texte qui ne froisse personne parce qu’il ne dit rien de vraiment tranchant. Un texte qui « sonne juste » parce qu’il a entendu mille fois les mêmes sons. Un texte validable. Présentable. Défendable en comité. Mort à l’arrivée.

L’IA générative n’a donc pas créé la langue de bois des RP. Elle lui a offert une chaîne de production. Avant, le mauvais texte demandait encore un effort. Il fallait le produire, même mollement. Il fallait choisir ses clichés, assembler ses prudences, maquiller ses banalités. Aujourd’hui, il se génère en trente secondes, avec des transitions propres, une syntaxe impeccable et ce petit vernis de sérieux qui donne l’impression qu’un adulte a relu.

La platitude a changé d’échelle. Elle ne circule plus seulement par imitation, par réflexe ou par paresse. Elle sort d’un outil ouvert en permanence dans l’onglet d’à côté. Elle s’adapte au secteur, au ton, au client. Elle ne se plaint jamais. Elle ne demande pas de brief clair. Elle livre. Le danger n’est pas que l’IA écrive à notre place. Le danger est qu’elle nous réapprenne à écrire comme elle.

Signer un texte qu’on n’a pas vraiment écrit

Un attaché de presse qui signe un communiqué généré sans relecture critique ne signe plus grand-chose. Ou plutôt, il signe le communiqué moyen de toute la profession, calculé à partir de ce que tout le monde a produit avant lui. Une forme de plagiat collectif inconscient. Personne ne vole personne. Tout le monde se ressemble.

La valeur d’un professionnel des RP, pourtant, se loge précisément là où l’IA échoue : dans le refus. L’argument écarté parce qu’il sonne faux. Le mot remplacé parce qu’il a déjà trop servi. L’angle retravaillé parce que le premier jet était trop sage. Le paragraphe supprimé parce qu’il rassure le client, mais n’intéressera aucun journaliste.

Ce travail là reste invisible. Il ne brille pas dans une démo. Il ne se mesure pas au nombre de signes générés. Il ne donne pas l’ivresse du texte produit en trente secondes. Mais il fonde le métier.

Une IA produit volontiers un premier jet sage. Elle aligne, harmonise, reformule, polit les aspérités. Elle donne une base. Très bien. Encore faut-il que quelqu’un ait ensuite le courage de l’abîmer, de la contredire, de la rendre spécifique. Si personne ne reprend la main, la machine a statistiquement gagné.

La question n’est plus « faut-il utiliser l’IA ? ». Pour beaucoup d’usages, la réponse est déjà oui. Rédiger une base, structurer des idées, tester des angles, reformuler un passage trop lourd, accélérer une recherche préparatoire : l’outil est remarquable. Le sujet commence ailleurs.

Qui parle, dans ce texte ? Si la réponse honnête est « je ne sais plus très bien », quelque chose s’est perdu en route. Et ce quelque chose ressemble beaucoup à ce pour quoi les clients paient.

Les RP ont encore une responsabilité éditoriale

Les RP ont construit leur légitimité sur une promesse : une parole choisie, au service d’une information vraie, transmise à des journalistes capables de distinguer une source d’un communiqué. Cette promesse tient encore. Mais elle se fragilise à chaque texte qui « incarne un narratif résilient » sans que personne n’ait décidé pourquoi ni même remarqué que la phrase ne veut rien dire.

Revendiquer une souveraineté éditoriale n’a rien d’une posture de vieux schnock nostalgique. C’est la condition pour que ce métier reste un métier, et pas un service de mise en forme automatisé facturé à la louche.

Le vrai filtre n’est pas technique. Il est professionnel. Il tient à une série de questions simples, presque brutales : est-ce exact ? Est-ce utile ? Est-ce nécessaire ? Est-ce dit comme tout le monde ? Est-ce que cette phrase survivrait à un journaliste pressé, sceptique, fatigué, vaguement hostile ? Si la réponse est non, il ne faut pas optimiser le prompt. Il faut reprendre le texte.

L’IA sait produire le communiqué que tout le monde attendait. Le métier commence quand quelqu’un décide que ce n’est pas assez.

Bruno SANVOISIN

Co-Président du SYNAP